HBaseзЃАдїЛ

HBase вАУ Hadoop DatabaseпЉМжШѓдЄАдЄ™йЂШеПѓйЭ†жАІгАБйЂШжАІиГљгАБйЭҐеРСеИЧгАБеПѓдЉЄзЉ©зЪДеИЖеЄГеЉПе≠ШеВ®з≥їзїЯпЉМеИ©зФ®HBaseжКАжЬѓеПѓеЬ®еїЙдїЈPC ServerдЄКжР≠еїЇиµЈе§ІиІДж®°зїУжЮДеМЦе≠ШеВ®йЫЖзЊ§гАВHBaseжШѓGoogle BigtableзЪДеЉАжЇРеЃЮзО∞пЉМз±їдЉЉGoogle BigtableеИ©зФ®GFSдљЬдЄЇеЕґжЦЗдїґе≠ШеВ®з≥їзїЯпЉМHBaseеИ©зФ®Hadoop HDFSдљЬдЄЇеЕґжЦЗдїґе≠ШеВ®з≥їзїЯпЉЫGoogleињРи°МMapReduceжЭ•е§ДзРЖBigtableдЄ≠зЪДжµЈйЗПжХ∞жНЃпЉМHBaseеРМж†ЈеИ©зФ®Hadoop MapReduceжЭ•е§ДзРЖHBaseдЄ≠зЪДжµЈйЗПжХ∞жНЃпЉЫGoogle BigtableеИ©зФ® ChubbyдљЬдЄЇеНПеРМжЬНеК°пЉМHBaseеИ©зФ®ZookeeperдљЬдЄЇеѓєеЇФгАВ

дЄКеЫЊжППињ∞дЇЖHadoop EcoSystemдЄ≠зЪДеРДе±Вз≥їзїЯпЉМеЕґдЄ≠HBaseдљНдЇОзїУжЮДеМЦе≠ШеВ®е±ВпЉМHadoop HDFSдЄЇHBaseжПРдЊЫдЇЖйЂШеПѓйЭ†жАІзЪДеЇХе±Ве≠ШеВ®жФѓжМБпЉМHadoop MapReduceдЄЇHBaseжПРдЊЫдЇЖйЂШжАІиГљзЪДиЃ°зЃЧиГљеКЫпЉМZookeeperдЄЇHBaseжПРдЊЫдЇЖз®≥еЃЪжЬНеК°еТМfailoverжЬЇеИґгАВж≠§е§ЦпЉМPigеТМHiveињШдЄЇHBaseжПРдЊЫдЇЖйЂШе±Виѓ≠и®АжФѓжМБпЉМдљњеЊЧеЬ®HBaseдЄКињЫи°МжХ∞жНЃзїЯиЃ°е§ДзРЖеПШзЪДйЭЮеЄЄзЃАеНХгАВ SqoopеИЩдЄЇHBaseжПРдЊЫдЇЖжЦєдЊњзЪДRDBMSжХ∞жНЃеѓЉеЕ•еКЯиГљпЉМдљњеЊЧдЉ†зїЯжХ∞жНЃеЇУжХ∞жНЃеРСHBaseдЄ≠ињБзІїеПШзЪДйЭЮеЄЄжЦєдЊњгАВ

HBaseиЃњйЧЃжО•еП£

1.¬† ¬†¬† ¬† Native Java APIпЉМжЬАеЄЄиІДеТМйЂШжХИзЪДиЃњйЧЃжЦєеЉПпЉМйАВеРИHadoop MapReduce Jobеєґи°МжЙєе§ДзРЖHBaseи°®жХ∞жНЃ

2.¬† ¬†¬† ¬† HBase ShellпЉМHBaseзЪДеСљдї§и°МеЈ•еЕЈпЉМжЬАзЃАеНХзЪДжО•еП£пЉМйАВеРИHBaseзЃ°зРЖдљњзФ®

3.¬† ¬†¬† ¬† Thrift GatewayпЉМеИ©зФ®ThriftеЇПеИЧеМЦжКАжЬѓпЉМжФѓжМБC++пЉМPHPпЉМPythonз≠Йе§ЪзІНиѓ≠и®АпЉМйАВеРИеЕґдїЦеЉВжЮДз≥їзїЯеЬ®зЇњиЃњйЧЃHBaseи°®жХ∞жНЃ

4.¬† ¬†¬† ¬† REST GatewayпЉМжФѓжМБREST й£Ож†ЉзЪДHttp APIиЃњйЧЃHBase, иІ£йЩ§дЇЖиѓ≠и®АйЩРеИґ

5.¬† ¬†¬† ¬† PigпЉМеПѓдї•дљњзФ®Pig LatinжµБеЉПзЉЦз®Лиѓ≠и®АжЭ•жУНдљЬHBaseдЄ≠зЪДжХ∞жНЃпЉМеТМHiveз±їдЉЉпЉМжЬђиі®жЬАзїИдєЯжШѓзЉЦиѓСжИРMapReduce JobжЭ•е§ДзРЖHBaseи°®жХ∞жНЃпЉМйАВеРИеБЪжХ∞жНЃзїЯиЃ°6.¬† ¬†¬† ¬† HiveпЉМељУеЙНHiveзЪДReleaseзЙИжЬђе∞Ъж≤°жЬЙеК†еЕ•еѓєHBaseзЪДжФѓжМБпЉМдљЖеЬ®дЄЛдЄАдЄ™зЙИжЬђHive 0.7.0дЄ≠е∞ЖдЉЪжФѓжМБHBaseпЉМеПѓдї•дљњзФ®з±їдЉЉSQLиѓ≠и®АжЭ•иЃњйЧЃ

HBaseHBaseжХ∞жНЃж®°еЮЛTable & Column Family

√Ш¬†¬†Row Key: и°МйФЃпЉМTableзЪДдЄїйФЃпЉМTableдЄ≠зЪДиЃ∞ељХжМЙзЕІRow KeyжОТеЇП√Ш¬†¬†Timestamp: жЧґйЧіжИ≥пЉМжѓПжђ°жХ∞жНЃжУНдљЬеѓєеЇФзЪДжЧґйЧіжИ≥пЉМеПѓдї•зЬЛдљЬжШѓжХ∞жНЃзЪДversion number√Ш¬†¬†Column FamilyпЉЪеИЧз∞ЗпЉМTableеЬ®ж∞іеє≥жЦєеРСжЬЙдЄАдЄ™жИЦиАЕе§ЪдЄ™Column FamilyзїДжИРпЉМдЄАдЄ™Column FamilyдЄ≠еПѓдї•зФ±дїїжДПе§ЪдЄ™ColumnзїДжИРпЉМеН≥Column FamilyжФѓжМБеК®жАБжЙ©е±ХпЉМжЧ†йЬАйҐДеЕИеЃЪдєЙColumnзЪДжХ∞йЗПдї•еПКз±їеЮЛпЉМжЙАжЬЙColumnеЭЗдї•дЇМињЫеИґж†ЉеЉПе≠ШеВ®пЉМзФ®жИЈйЬАи¶БиЗ™и°МињЫи°Мз±їеЮЛиљђжНҐгАВ

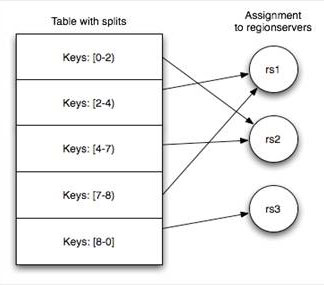

Table & Region

ељУTableйЪПзЭАиЃ∞ељХжХ∞дЄНжЦ≠еҐЮеК†иАМеПШе§ІеРОпЉМдЉЪйАРжЄРеИЖи£ВжИРе§ЪдїљsplitsпЉМжИРдЄЇregionsпЉМдЄАдЄ™regionзФ±[startkey,endkey)и°®з§ЇпЉМдЄНеРМзЪДregionдЉЪ襀MasterеИЖйЕНзїЩзЫЄеЇФзЪДRegionServerињЫи°МзЃ°зРЖпЉЪ

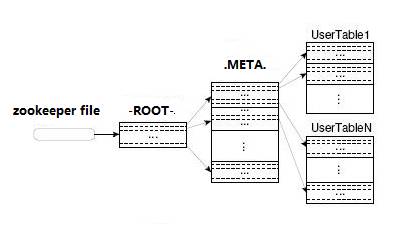

-ROOT- && .META. Table

HBaseдЄ≠жЬЙдЄ§еЉ†зЙєжЃКзЪДTableпЉМ-ROOT-еТМ.META.√Ш¬†¬†.META.пЉЪиЃ∞ељХдЇЖзФ®жИЈи°®зЪДRegionдњ°жБѓпЉМ.META.еПѓдї•жЬЙе§ЪдЄ™regoin√Ш¬†¬†-ROOT-пЉЪиЃ∞ељХдЇЖ.META.и°®зЪДRegionдњ°жБѓпЉМ-ROOT-еП™жЬЙдЄАдЄ™region√Ш¬†¬†ZookeeperдЄ≠иЃ∞ељХдЇЖ-ROOT-и°®зЪДlocation

ClientиЃњйЧЃзФ®жИЈжХ∞жНЃдєЛеЙНйЬАи¶Бй¶ЦеЕИиЃњйЧЃzookeeperпЉМзДґеРОиЃњйЧЃ-ROOT-и°®пЉМжО•зЭАиЃњйЧЃ.META.и°®пЉМжЬАеРОжЙНиГљжЙЊеИ∞зФ®жИЈжХ∞жНЃзЪДдљНзљЃеОїиЃњйЧЃпЉМдЄ≠йЧійЬАи¶Бе§Ъжђ°зљСзїЬжУНдљЬпЉМдЄНињЗclientзЂѓдЉЪеБЪcacheзЉУе≠ШгАВ

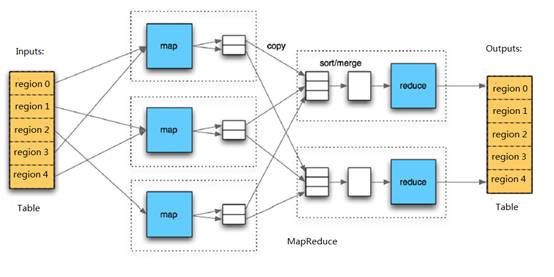

MapReduce on HBase

еЬ®HBaseз≥їзїЯдЄКињРи°МжЙєе§ДзРЖињРзЃЧпЉМжЬАжЦєдЊњеТМеЃЮзФ®зЪДж®°еЮЛдЊЭзДґжШѓMapReduceпЉМе¶ВдЄЛеЫЊпЉЪ

HBase TableеТМRegionзЪДеЕ≥з≥їпЉМжѓФиЊГз±їдЉЉHDFS FileеТМBlockзЪДеЕ≥з≥їпЉМHBaseжПРдЊЫдЇЖйЕНе•ЧзЪДTableInputFormatеТМTableOutputFormat APIпЉМеПѓдї•жЦєдЊњзЪДе∞ЖHBase TableдљЬдЄЇHadoop MapReduceзЪДSourceеТМSinkпЉМеѓєдЇОMapReduce JobеЇФзФ®еЉАеПСдЇЇеСШжЭ•иѓіпЉМеЯЇжЬђдЄНйЬАи¶БеЕ≥ж≥®HBaseз≥їзїЯиЗ™иЇЂзЪДзїЖиКВгАВ

HBaseз≥їзїЯжЮґжЮД

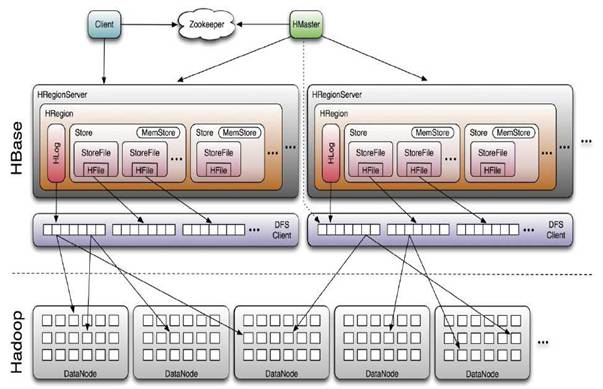

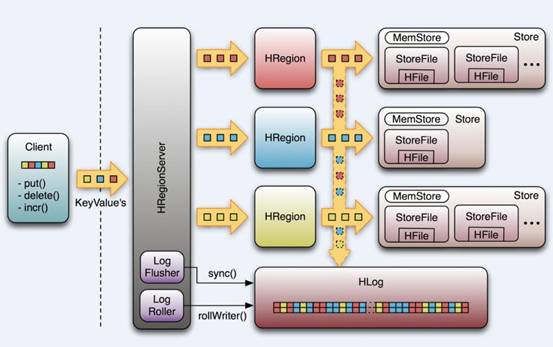

Client

HBase ClientдљњзФ®HBaseзЪДRPCжЬЇеИґдЄОHMasterеТМHRegionServerињЫи°МйАЪдњ°пЉМеѓєдЇОзЃ°зРЖз±їжУНдљЬпЉМClientдЄОHMasterињЫи°МRPCпЉЫеѓєдЇОжХ∞жНЃиѓїеЖЩз±їжУНдљЬпЉМClientдЄОHRegionServerињЫи°МRPC

Zookeeper

Zookeeper QuorumдЄ≠йЩ§дЇЖе≠ШеВ®дЇЖ-ROOT-и°®зЪДеЬ∞еЭАеТМHMasterзЪДеЬ∞еЭАпЉМHRegionServerдєЯдЉЪжККиЗ™еЈ±дї•EphemeralжЦєеЉПж≥®еЖМеИ∞ZookeeperдЄ≠пЉМдљњеЊЧHMasterеПѓдї•йЪПжЧґжДЯзЯ•еИ∞еРДдЄ™HRegionServerзЪДеБ•еЇЈзКґжАБгАВж≠§е§ЦпЉМZookeeperдєЯйБњеЕНдЇЖHMasterзЪДеНХзВєйЧЃйҐШпЉМиІБдЄЛжЦЗжППињ∞HMasterHMasterж≤°жЬЙеНХзВєйЧЃйҐШпЉМHBaseдЄ≠еПѓдї•еРѓеК®е§ЪдЄ™HMasterпЉМйАЪињЗZookeeperзЪДMaster ElectionжЬЇеИґдњЭиѓБжАїжЬЙдЄАдЄ™MasterињРи°МпЉМHMasterеЬ®еКЯиГљдЄКдЄїи¶БиіЯиі£TableеТМRegionзЪДзЃ°зРЖеЈ•дљЬпЉЪ

1.¬† ¬†¬† ¬† зЃ°зРЖзФ®жИЈеѓєTableзЪДеҐЮгАБеИ†гАБжФєгАБжЯ•жУНдљЬ

2.¬† ¬†¬† ¬† зЃ°зРЖHRegionServerзЪДиіЯиљљеЭЗи°°пЉМи∞ГжХіRegionеИЖеЄГ

3.¬† ¬†¬† ¬† еЬ®Region SplitеРОпЉМиіЯиі£жЦ∞RegionзЪДеИЖйЕН

4.¬† ¬†¬† ¬† еЬ®HRegionServerеБЬжЬЇеРОпЉМиіЯиі£е§±жХИHRegionServer дЄКзЪДRegionsињБзІїHRegionServerHRegionServerдЄїи¶БиіЯиі£еУНеЇФзФ®жИЈI/OиѓЈж±ВпЉМеРСHDFSжЦЗдїґз≥їзїЯдЄ≠иѓїеЖЩжХ∞жНЃпЉМжШѓHBaseдЄ≠жЬАж†ЄењГзЪДж®°еЭЧгАВ

HRegionServerеЖЕйГ®зЃ°зРЖдЇЖдЄАз≥їеИЧHRegionеѓєи±°пЉМжѓПдЄ™HRegionеѓєеЇФдЇЖTableдЄ≠зЪДдЄАдЄ™RegionпЉМHRegionдЄ≠зФ±е§ЪдЄ™HStoreзїДжИРгАВжѓПдЄ™HStoreеѓєеЇФдЇЖTableдЄ≠зЪДдЄАдЄ™Column FamilyзЪДе≠ШеВ®пЉМеПѓдї•зЬЛеЗЇжѓПдЄ™Column FamilyеЕґеЃЮе∞±жШѓдЄАдЄ™йЫЖдЄ≠зЪДе≠ШеВ®еНХеЕГпЉМеЫ†ж≠§жЬАе•ље∞ЖеЕЈе§ЗеЕ±еРМIOзЙєжАІзЪДcolumnжФЊеЬ®дЄАдЄ™Column FamilyдЄ≠пЉМињЩж†ЈжЬАйЂШжХИгАВHStoreе≠ШеВ®жШѓHBaseе≠ШеВ®зЪДж†ЄењГдЇЖпЉМеЕґдЄ≠зФ±дЄ§йГ®еИЖзїДжИРпЉМдЄАйГ®еИЖжШѓMemStoreпЉМдЄАйГ®еИЖжШѓStoreFilesгАВMemStoreжШѓSorted Memory BufferпЉМзФ®жИЈеЖЩеЕ•зЪДжХ∞жНЃй¶ЦеЕИдЉЪжФЊеЕ•MemStoreпЉМељУMemStoreжї°дЇЖдї•еРОдЉЪFlushжИРдЄАдЄ™StoreFileпЉИеЇХе±ВеЃЮзО∞жШѓHFileпЉЙпЉМељУStoreFileжЦЗдїґжХ∞йЗПеҐЮйХњеИ∞дЄАеЃЪйШИеАЉпЉМдЉЪиІ¶еПСCompactеРИеєґжУНдљЬпЉМе∞Же§ЪдЄ™StoreFilesеРИеєґжИРдЄАдЄ™StoreFileпЉМеРИеєґињЗз®ЛдЄ≠дЉЪињЫи°МзЙИжЬђеРИеєґеТМжХ∞жНЃеИ†йЩ§пЉМеЫ†ж≠§еПѓдї•зЬЛеЗЇHBaseеЕґеЃЮеП™жЬЙеҐЮеК†жХ∞жНЃпЉМжЙАжЬЙзЪДжЫіжЦ∞еТМеИ†йЩ§жУНдљЬйГљжШѓеЬ®еРОзї≠зЪДcompactињЗз®ЛдЄ≠ињЫи°МзЪДпЉМињЩдљњеЊЧзФ®жИЈзЪДеЖЩжУНдљЬеП™и¶БињЫеЕ•еЖЕе≠ШдЄ≠е∞±еПѓдї•зЂЛеН≥ињФеЫЮпЉМдњЭиѓБдЇЖHBase I/OзЪДйЂШжАІиГљгАВељУStoreFiles CompactеРОпЉМдЉЪйАРж≠•ељҐжИРиґКжЭ•иґКе§ІзЪДStoreFileпЉМељУеНХдЄ™StoreFileе§Іе∞ПиґЕињЗдЄАеЃЪйШИеАЉеРОпЉМдЉЪиІ¶еПСSplitжУНдљЬпЉМеРМжЧґжККељУеЙНRegion SplitжИР2дЄ™RegionпЉМзИґRegionдЉЪдЄЛзЇњпЉМжЦ∞SplitеЗЇзЪД2дЄ™е≠©е≠РRegionдЉЪ襀HMasterеИЖйЕНеИ∞зЫЄеЇФзЪДHRegionServerдЄКпЉМдљњеЊЧеОЯеЕИ1дЄ™RegionзЪДеОЛеКЫеЊЧдї•еИЖжµБеИ∞2дЄ™RegionдЄКгАВдЄЛеЫЊжППињ∞дЇЖCompactionеТМSplitзЪДињЗз®ЛпЉЪ

еЬ®зРЖиІ£дЇЖдЄКињ∞HStoreзЪДеЯЇжЬђеОЯзРЖеРОпЉМињШењЕй°їдЇЖиІ£дЄАдЄЛHLogзЪДеКЯиГљпЉМеЫ†дЄЇдЄКињ∞зЪДHStoreеЬ®з≥їзїЯж≠£еЄЄеЈ•дљЬзЪДеЙНжПРдЄЛжШѓж≤°жЬЙйЧЃйҐШзЪДпЉМдљЖжШѓеЬ®еИЖеЄГеЉПз≥їзїЯзОѓеҐГдЄ≠пЉМжЧ†ж≥ХйБњеЕНз≥їзїЯеЗЇйФЩжИЦиАЕеЃХжЬЇпЉМеЫ†ж≠§дЄАжЧ¶HRegionServerжДПе§ЦйААеЗЇпЉМMemStoreдЄ≠зЪДеЖЕе≠ШжХ∞жНЃе∞ЖдЉЪ䪥姱пЉМињЩе∞±йЬАи¶БеЉХеЕ•HLogдЇЖгАВжѓПдЄ™HRegionServerдЄ≠йГљжЬЙдЄАдЄ™HLogеѓєи±°пЉМHLogжШѓдЄАдЄ™еЃЮзО∞Write Ahead LogзЪДз±їпЉМеЬ®жѓПжђ°зФ®жИЈжУНдљЬеЖЩеЕ•MemStoreзЪДеРМжЧґпЉМдєЯдЉЪеЖЩдЄАдїљжХ∞жНЃеИ∞HLogжЦЗдїґдЄ≠пЉИHLogжЦЗдїґж†ЉеЉПиІБеРОзї≠пЉЙпЉМHLogжЦЗдїґеЃЪжЬЯдЉЪжїЪеК®еЗЇжЦ∞зЪДпЉМеєґеИ†йЩ§жЧІзЪДжЦЗдїґпЉИеЈ≤жМБдєЕеМЦеИ∞StoreFileдЄ≠зЪДжХ∞жНЃпЉЙгАВељУHRegionServerжДПе§ЦзїИж≠ҐеРОпЉМHMasterдЉЪйАЪињЗZookeeperжДЯзЯ•еИ∞пЉМHMasterй¶ЦеЕИдЉЪе§ДзРЖйБЧзХЩзЪД HLogжЦЗдїґпЉМе∞ЖеЕґдЄ≠дЄНеРМRegionзЪДLogжХ∞жНЃињЫи°МжЛЖеИЖпЉМеИЖеИЂжФЊеИ∞зЫЄеЇФregionзЪДзЫЃељХдЄЛпЉМзДґеРОеЖНе∞Ж姱жХИзЪДregionйЗНжЦ∞еИЖйЕНпЉМйҐЖеПЦ еИ∞ињЩдЇЫregionзЪДHRegionServerеЬ®Load RegionзЪДињЗз®ЛдЄ≠пЉМдЉЪеПСзО∞жЬЙеОЖеП≤HLogйЬАи¶Бе§ДзРЖпЉМеЫ†ж≠§дЉЪReplay HLogдЄ≠зЪДжХ∞жНЃеИ∞MemStoreдЄ≠пЉМзДґеРОflushеИ∞StoreFilesпЉМеЃМжИРжХ∞жНЃжБҐе§НгАВ

HBaseе≠ШеВ®ж†ЉеЉП

HBaseдЄ≠зЪДжЙАжЬЙжХ∞жНЃжЦЗдїґйГље≠ШеВ®еЬ®Hadoop HDFSжЦЗдїґз≥їзїЯдЄКпЉМдЄїи¶БеМЕжЛђдЄКињ∞жПРеЗЇзЪДдЄ§зІНжЦЗдїґз±їеЮЛпЉЪ

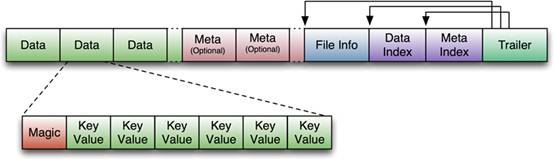

1.¬† ¬†¬† ¬† HFileпЉМ HBaseдЄ≠KeyValueжХ∞жНЃзЪДе≠ШеВ®ж†ЉеЉПпЉМHFileжШѓHadoopзЪДдЇМињЫеИґж†ЉеЉПжЦЗдїґпЉМеЃЮйЩЕдЄКStoreFileе∞±жШѓеѓєHFileеБЪдЇЖиљїйЗПзЇІеМЕи£ЕпЉМеН≥StoreFileеЇХе±Ве∞±жШѓHFile

2.¬† ¬†¬† ¬† HLog FileпЉМHBaseдЄ≠WALпЉИWrite Ahead LogпЉЙ зЪДе≠ШеВ®ж†ЉеЉПпЉМзЙ©зРЖдЄКжШѓHadoopзЪДSequence FileHFileдЄЛеЫЊжШѓHFileзЪДе≠ШеВ®ж†ЉеЉПпЉЪ¬†¬†

й¶ЦеЕИHFileжЦЗдїґжШѓдЄНеЃЪйХњзЪДпЉМйХњеЇ¶еЫЇеЃЪзЪДеП™жЬЙеЕґдЄ≠зЪДдЄ§еЭЧпЉЪTrailerеТМFileInfoгАВж≠£е¶ВеЫЊдЄ≠жЙАз§ЇзЪДпЉМTrailerдЄ≠жЬЙжМЗйТИжМЗеРСеЕґдїЦжХ∞жНЃеЭЧзЪДиµЈеІЛзВєгАВFile InfoдЄ≠иЃ∞ељХдЇЖжЦЗдїґзЪДдЄАдЇЫMetaдњ°жБѓпЉМдЊЛе¶ВпЉЪAVG_KEY_LEN, AVG_VALUE_LEN, LAST_KEY, COMPARATOR, MAX_SEQ_ID_KEYз≠ЙгАВData IndexеТМMeta IndexеЭЧиЃ∞ељХдЇЖжѓПдЄ™DataеЭЧеТМMetaеЭЧзЪДиµЈеІЛзВєгАВData BlockжШѓHBase I/OзЪДеЯЇжЬђеНХеЕГпЉМдЄЇдЇЖжПРйЂШжХИзОЗпЉМHRegionServerдЄ≠жЬЙеЯЇдЇОLRUзЪДBlock CacheжЬЇеИґгАВжѓПдЄ™DataеЭЧзЪДе§Іе∞ПеПѓдї•еЬ®еИЫеїЇдЄАдЄ™TableзЪДжЧґеАЩйАЪињЗеПВжХ∞жМЗеЃЪпЉМе§ІеПЈзЪДBlockжЬЙеИ©дЇОй°ЇеЇПScanпЉМе∞ПеПЈBlockеИ©дЇОйЪПжЬЇжߕ胥гАВжѓПдЄ™DataеЭЧйЩ§дЇЖеЉАе§ізЪДMagicдї•е§Це∞±жШѓдЄАдЄ™дЄ™KeyValueеѓєжЛЉжО•иАМжИР, MagicеЖЕеЃєе∞±жШѓдЄАдЇЫйЪПжЬЇжХ∞е≠ЧпЉМзЫЃзЪДжШѓйШ≤ж≠ҐжХ∞жНЃжНЯеЭПгАВеРОйЭҐдЉЪиѓ¶зїЖдїЛзїНжѓПдЄ™KeyValueеѓєзЪДеЖЕйГ®жЮДйА†гАВHFileйЗМйЭҐзЪДжѓПдЄ™KeyValueеѓєе∞±жШѓдЄАдЄ™зЃАеНХзЪДbyteжХ∞зїДгАВдљЖжШѓињЩдЄ™byteжХ∞зїДйЗМйЭҐеМЕеРЂдЇЖеЊИе§Ъй°єпЉМеєґдЄФжЬЙеЫЇеЃЪзЪДзїУжЮДгАВжИСдїђжЭ•зЬЛзЬЛйЗМйЭҐзЪДеЕЈдљУзїУжЮДпЉЪ

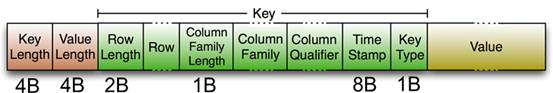

еЉАеІЛжШѓдЄ§дЄ™еЫЇеЃЪйХњеЇ¶зЪДжХ∞еАЉпЉМеИЖеИЂи°®з§ЇKeyзЪДйХњеЇ¶еТМValueзЪДйХњеЇ¶гАВзіІжО•зЭАжШѓKeyпЉМеЉАеІЛжШѓеЫЇеЃЪйХњеЇ¶зЪДжХ∞еАЉпЉМи°®з§ЇRowKeyзЪДйХњеЇ¶пЉМзіІжО•зЭАжШѓRowKeyпЉМзДґеРОжШѓеЫЇеЃЪйХњеЇ¶зЪДжХ∞еАЉпЉМи°®з§ЇFamilyзЪДйХњеЇ¶пЉМзДґеРОжШѓFamilyпЉМжО•зЭАжШѓQualifierпЉМзДґеРОжШѓдЄ§дЄ™еЫЇеЃЪйХњеЇ¶зЪДжХ∞еАЉпЉМи°®з§ЇTime StampеТМKey TypeпЉИPut/DeleteпЉЙгАВValueйГ®еИЖж≤°жЬЙињЩдєИе§НжЭВзЪДзїУжЮДпЉМе∞±жШѓзЇѓз≤єзЪДдЇМињЫеИґжХ∞жНЃдЇЖгАВ

HLogFile

<IGNORE_JS_OP style="WORD-WRAP: break-word">

image0100.jpg¬†(21.7 KB, дЄЛиљљжђ°жХ∞: 0)

дЄКеЫЊдЄ≠з§ЇжДПдЇЖHLogжЦЗдїґзЪДзїУжЮДпЉМеЕґеЃЮHLogжЦЗдїґе∞±жШѓдЄАдЄ™жЩЃйАЪзЪДHadoop Sequence FileпЉМSequence File зЪДKeyжШѓHLogKeyеѓєи±°пЉМHLogKeyдЄ≠иЃ∞ељХдЇЖеЖЩеЕ•жХ∞жНЃзЪДељТе±Юдњ°жБѓпЉМйЩ§дЇЖtableеТМregionеРНе≠Че§ЦпЉМеРМжЧґињШеМЕжЛђ sequence numberеТМtimestampпЉМtimestampжШѓвАЬеЖЩеЕ•жЧґйЧівАЭпЉМsequence numberзЪДиµЈеІЛеАЉдЄЇ0пЉМжИЦиАЕжШѓжЬАињСдЄАжђ°е≠ШеЕ•жЦЗдїґз≥їзїЯдЄ≠sequence numberгАВHLog Sequece FileзЪДValueжШѓHBaseзЪДKeyValueеѓєи±°пЉМеН≥еѓєеЇФHFileдЄ≠зЪДKeyValueпЉМеПѓеПВиІБдЄКжЦЗжППињ∞гАВ

зЫЄеЕ≥жО®иНР

4.1 ж¶Вињ∞ 4.2 HBaseиЃњйЧЃжО•еП£ 4.3 HBaseжХ∞жНЃж®°еЮЛ 4.4 HBaseзЪДеЃЮзО∞еОЯзРЖ 4.5 HBaseињРи°МжЬЇеИґ 4.6 HBaseеЇФзФ®жЦєж°И 4.7 HBaseзЉЦз®ЛеЃЮиЈµ

вАҐз≥їзїЯеЬ∞иЃЇињ∞дЇЖе§ІжХ∞жНЃзЪДеЯЇжЬђж¶ВењµгАБе§ІжХ∞жНЃе§ДзРЖжЮґжЮДHadoopгАБеИЖеЄГеЉПжЦЗдїґз≥їзїЯHDFSгАБеИЖеЄГеЉПжХ∞жНЃеЇУHBaseгАБNoSQLжХ∞жНЃеЇУгАБдЇСжХ∞жНЃеЇУгАБеИЖеЄГеЉПеєґи°МзЉЦз®Лж®°еЮЛMapReduceгАБжµБиЃ°зЃЧгАБеЫЊиЃ°зЃЧгАБжХ∞жНЃеПѓиІЖеМЦдї•еПКе§ІжХ∞жНЃеЬ®дЇТиБФзљСгАБзФЯзЙ©еМїе≠¶...

HBase вАУ Hadoop DatabaseпЉМжШѓдЄАдЄ™йЂШеПѓйЭ†жАІгАБйЂШжАІиГљгАБйЭҐеРСеИЧгАБеПѓдЉЄзЉ©зЪДеИЖеЄГеЉПе≠ШеВ®з≥їзїЯпЉМеИ©зФ®HBaseжКАжЬѓеПѓеЬ®еїЙдїЈPC ServerдЄКжР≠еїЇиµЈе§ІиІДж®°зїУжЮДеМЦе≠ШеВ®йЫЖзЊ§гАВ HBaseжШѓGoogle BigtableзЪДеЉАжЇРеЃЮзО∞пЉМз±їдЉЉGoogle BigtableеИ©зФ®...

иѓЊз®Ле∞Жз≥їзїЯиЃ≤жОИе§ІжХ∞жНЃзЪДеЯЇжЬђж¶ВењµгАБе§ІжХ∞жНЃе§ДзРЖжЮґжЮДHadoopгАБеИЖеЄГеЉПжЦЗдїґз≥їзїЯHDFSгАБеИЖеЄГеЉПжХ∞жНЃеЇУHBaseгАБNoSQLжХ∞жНЃеЇУгАБдЇСжХ∞жНЃеЇУгАБеИЖеЄГеЉПеєґи°МзЉЦз®Лж®°еЮЛMapReduceгАБжµБиЃ°зЃЧгАБеЫЊиЃ°зЃЧгАБжХ∞жНЃеПѓиІЖеМЦдї•еПКе§ІжХ∞жНЃеЬ®дЇТиБФзљСгАБзФЯзЙ©еМїе≠¶...

HBase вАУ Hadoop DatabaseпЉМжШѓдЄАдЄ™йЂШеПѓйЭ†жАІгАБйЂШжАІиГљгАБйЭҐеРСеИЧгАБеПѓдЉЄзЉ©зЪДеИЖеЄГеЉПе≠ШеВ®з≥їзїЯпЉМеИ©зФ®HBaseжКАжЬѓеПѓеЬ®еїЙдїЈPC ServerдЄКжР≠еїЇиµЈе§ІиІДж®°зїУжЮДеМЦе≠ШеВ®йЫЖзЊ§гАВ HBaseжШѓGoogle BigtableзЪДеЉАжЇРеЃЮзО∞пЉМз±їдЉЉGoogle BigtableеИ©зФ®...

4-е§ІжХ∞жНЃеѓЉиЃЇ-зђђеЫЫзЂ†-еИЖеЄГеЉПжХ∞жНЃеЇУHBaseпЉИеЕ±71й°µпЉЙ.ppt 5-е§ІжХ∞жНЃеѓЉиЃЇ-зђђдЇФзЂ†-NoSQLжХ∞жНЃеЇУпЉИеЕ±63й°µпЉЙ.ppt 6-е§ІжХ∞жНЃеѓЉиЃЇ-зђђеЕ≠зЂ†-дЇСжХ∞жНЃеЇУпЉИеЕ±44й°µпЉЙ.ppt 7-е§ІжХ∞жНЃеѓЉиЃЇ-зђђдЄГзЂ†-MapReduceпЉИеЕ±38й°µпЉЙ.ppt 8-е§ІжХ∞жНЃеѓЉиЃЇ-зђђ...

hbaseжШѓеЯЇдЇОhdfsињЫи°МжХ∞жНЃзЪДеИЖеЄГеЉПе≠ШеВ®пЉМеЕЈжЬЙйЂШеПѓйЭ†гАБйЂШжАІиГљгАБеИЧе≠ШеВ®гАБеПѓдЉЄзЉ©гАБеЃЮжЧґиѓїеЖЩзЪДnosqlжХ∞жНЃеЇУгАВ hbaseеПѓдї•е≠ШеВ®жµЈйЗПзЪДжХ∞жНЃпЉМеєґдЄФеРОжЬЯжߕ胥жАІиГљеЊИйЂШпЉМеПѓдї•еЃЮзО∞дЄКдЇњжЭ°жХ∞жНЃзЪДжߕ胥зІТзЇІињФеЫЮзїУжЮЬгАВ 1.2 hbaseи°®зЪДзЙєжАІ...

еЬ®е§ІжХ∞жНЃзГ≠жљЃдЄ≠пЉМжО®еЗЇдЇЖNoSQLжХ∞жНЃеЇУпЉМињЩзІН姩зФЯе∞±дЄЇеИЖеЄГеЉПе≠ШеВ®иАМиЃЊиЃ°зЪДжКАжЬѓпЉМе∞§еЕґдї•Apache HBaseдЄЇдї£и°®пЉМеН†йҐЖжµЈйЗПжХ∞жНЃе≠ШеВ®жКАжЬѓзЪДе§ІеНКе£Бж±Яе±±гАВжЬђжХЩиІЖдїОеЃЮжИШиІТеЇ¶еЗЇжЭ•пЉМеРСе≠¶еСШдїђжЙЛжККжЙЛжОМжП°HBaseдљњзФ®з≤ЊйЂУпЉМиЃ©е≠¶еСШиЊЊеИ∞е¶ВдЄЛ...

зђђвЉЖйШґжЃµпЉМдЄїи¶БжШѓLinux&Hadoopвљ£жАБдљУз≥їзЪДе≠¶дє†пЉМеѓєдЇОLinuxдљУз≥їгАБHadoopз¶їзЇњиЃ°зЃЧвЉ§зЇ≤гАБеИЖеЄГеЉПжХ∞жНЃеЇУHbaseгАБжХ∞жНЃдїУеЇУHiveгАБжХ∞жНЃ ињБзІївЉѓеЕЈSqoopгАБFlumeеИЖеЄГеЉПвљЗењЧж°ЖжЮґз≠Йи¶БйАРж≠•еОїе≠¶дє†жОМжП°гАВ жО®иНРдє¶з±НпЉЪ гАКBig DataгАЛ еЬ®...

JanusGraphжШѓдЄАдЄ™дЇЛеК°жХ∞жНЃеЇУпЉМеПѓдї•жФѓжМБжХ∞еНГдЄ™еєґеПСзФ®жИЈпЉМе§НжЭВзЪДйБНеОЖеТМеИЖжЮРеЫЊжߕ胥гАВдЇЖиІ£жЫіе§ЪеМЕеРЂжЬЙеЕ≥JanusGraphзЪДжЫіе§Ъдњ°жБѓпЉМеєґжПРдЊЫдЇЖжМЗеРСжЦЗж°£пЉМеЕ•йЧ®жМЗеНЧеТМеПСи°МзЙИдЄЛиљљзЪДйУЊжО•гАВеПѓиІЖеМЦи¶БеПѓиІЖеМЦе≠ШеВ®еЬ®JanusGraphдЄ≠зЪДеی嚥...

дїОйЫґеЉАеІЛиЃ≤иІ£е§ІжХ∞жНЃеИЧеЉПе≠ШеВ®NoSQLжХ∞жНЃеЇУKuduпЉМеЯЇдЇОKuduжЮДеїЇйЂШжАІиГљйЪПжЬЇиѓїеЖЩиЃњйЧЃзЪДжХ∞жНЃе≠ШеВ®з≥їзїЯпЉМеОЯзРЖдїОеЕ•йЧ®еИ∞жЈ±еЕ•пЉМжРЮеЃЪйЭҐиѓХ иѓЊз®ЛдЇЃзВє 1пЉМзЯ•иѓЖдљУз≥їеЃМе§ЗпЉМдїОе∞ПзЩљеИ∞е§Із•ЮеРДйШґжЃµиѓїиАЕеЭЗиГље≠¶жЬЙжЙАиОЈгАВ 2пЉМзФЯеʮ嚥豰пЉМеМЦзєБдЄЇ...

6.2 иЃњйЧЃHBaseз≠ЙйЭҐеРСеИЧжХ∞жНЃеЇУдЄ≠зЪДжХ∞жНЃгАА111 6.3 жߕ胥RedisжХ∞жНЃе≠ШеВ®гАА113 6.4 е∞ПзїУгАА116 зђђ7зЂ† дњЃжФєжХ∞жНЃе≠ШеВ®еПКзЃ°зРЖжЉФињЫгАА117 7.1 дњЃжФєжЦЗж°£жХ∞жНЃеЇУгАА117 7.1.1 еЉ±schemaзЪДзБµжіїжАІгАА120 7.1.2 MongoDBзЪДжХ∞жНЃеѓЉеЕ•дЄОеѓЉеЗЇгАА...

java8 зЬЛдЄНеИ∞жЇРз†Б еЕ≥дЇО жМБзї≠йЫЖжИР жЙІзЕІ иБК姩 GeoWave жШѓдЄАе•ЧеЉАжЇРиљѓдїґпЉМеЃГеПѓдї•пЉЪ иГљеКЫ еРСйФЃ/еАЉе≠ШеВ®жЈїеК†е§Ъ翳糥еЉХеКЯиГљпЉИзЫЃеЙНпЉМ ...дЄЇеЬ∞зРЖз©ЇйЧіжХ∞жНЃзЪДеИЖеЄГеЉПе§ДзРЖеТМеИЖжЮРжПРдЊЫ ...зЪДеСљдї§и°МеЈ•еЕЈжЭ•еЄЃеК©жВ®еЕ•йЧ®ињЩйАЪеЄЄжШѓеЬ®жВ®иЗ™еЈ±зЪДжЬЇеЩ®дЄК

жХ∞жНЃе≠ШеВ®дЄОзЃ°зРЖпЉЪе≠¶дє†еИЖеЄГеЉПжЦЗдїґз≥їзїЯпЉИе¶ВHDFSпЉЙеТМжХ∞жНЃеЇУжКАжЬѓпЉИе¶ВHBaseгАБCassandraз≠ЙпЉЙпЉМдЇЖиІ£еЃГдїђеЬ®е§ІжХ∞жНЃе≠ШеВ®еТМзЃ°зРЖжЦєйЭҐзЪДдЉШеКњгАВ жХ∞жНЃе§ДзРЖдЄОеИЖжЮРпЉЪзЖЯжВЙжЙєе§ДзРЖж°ЖжЮґпЉИе¶ВApache SparkпЉЙеТМжµБе§ДзРЖж°ЖжЮґпЉИе¶ВApache FlinkпЉЙ...

е§ІжХ∞жНЃеЯЇз°АзЯ•иѓЖеЕ•йЧ® з§ЊдЉЪдњЭйЪЬдЇЛдЄЪйГ® еЉ†зБЂз£К дЄїи¶БеЖЕеЃє е§ІжХ∞жНЃдїЈеАЉ 03 е§ІжХ∞жНЃж¶ВењµгАБзЙєжАІгАБзФ±жЭ• 01 е§ІжХ∞жНЃеЇФзФ®дЄЊдЊЛ 04 02 HadoopжКАжЬѓдїЛзїН е§ІжХ∞жНЃж¶ВењµгАБзЙєжАІгАБзФ±жЭ• дїАдєИеПЂе§ІжХ∞жНЃпЉЯ йЇ¶иВѓйФ°еЕ®зРГз†Фз©ґжЙАзїЩеЗЇзЪДеЃЪдєЙжШѓпЉЪдЄА зІН...

JAVA еЯЇз°А Spring еОЯзРЖ ...жХ∞жНЃеЇУ дЄАиЗіжАІзЃЧж≥Х JAVA зЃЧж≥Х Spark йЫЖеРИ е§ЪзЇњз®ЛеєґеПС иЃЊиЃ°ж®°еЉП иіЯиљљеЭЗи°° жХ∞жНЃзїУжЮД еК†еѓЖзЃЧж≥Х еИЖеЄГеЉПзЉУе≠Ш жЬЇеЩ®е≠¶дє† дЇСиЃ°зЃЧ JVM Hbase MongoDB Cassandra Hadoop Storm YARN

AccumuloгАБHBaseгАБGoogle Bigtable еТМ Cassandra жХ∞жНЃеЇУдєЛдЄКжПРдЊЫж״穯糥еЉХпЉМзФ®дЇОзВєгАБзЇњеТМе§Ъ茺嚥жХ∞жНЃзЪДжµЈйЗПе≠ШеВ®гАВ GeoMesa ињШйАЪињЗеЬ® Apache Kafka дєЛдЄКеИЖе±Вз©ЇйЧіиѓ≠дєЙжЭ•жПРдЊЫжЧґз©ЇжХ∞жНЃзЪДињСеЃЮжЧґжµБе§ДзРЖгАВ йАЪињЗ GeoServerпЉМ...

NoSQLпЉИHBase/RedisгАВгАВгАВпЉЙ 2гАБеХЖдЄЪй©±еК® е§ІжХ∞жНЃзО∞е≠ШзЪДж®°еЉП жЙЛжП°е§ІжХ∞жНЃпЉМж≤°жЬЙе§ІжХ∞жНЃжАЭзїі ж≤°жЬЙе§ІжХ∞жНЃгАБжЬЙе§ІжХ∞жНЃжАЭзїі жЧҐжЬЙе§ІжХ∞жНЃгАБеПИжЬЙе§ІжХ∞жНЃжАЭзїі е§ІжХ∞жНЃжКАжЬѓж¶Вињ∞ еНХжЬЇпЉЪcpu memory disk еИЖеЄГеЉПеєґи°МиЃ°зЃЧ/е§ДзРЖ жХ∞жНЃйЗЗйЫЖ...

02-hiveзЪДеЕГжХ∞жНЃеЇУmysqlжЦєеЉПеЃЙи£ЕйЕНзљЃ.avi 03-hiveзЪДдљњзФ®.avi 04-hiveзЪДеЄЄзФ®иѓ≠ж≥Х.avi 05-hqlиѓ≠ж≥ХеПКиЗ™еЃЪдєЙеЗљжХ∞.avi 06-hbaseи°®зїУжЮД.avi 07-hbaseйЫЖзЊ§жЮґжЮДеПКи°®е≠ШеВ®жЬЇеИґ.avi 08-hbase-shell.avi 09-hbaseзЪДjava ...

еЕ®жЦєдљНиѓ¶зїЖжЈ±еЕ•йШРињ∞дїОеЕ•йЧ®еИ∞йЂШзЇІJavaз®ЛеЇПеСШењЕе§ЗзЪДзЯ•иѓЖжКАиГљгАВжМЙзЕІзО∞жЬЙиЃ°еИТпЉМдЄїи¶Бз†Фз©ґе¶ВдЄЛжЦєйЭҐзЯ•иѓЖзВєпЉЪ Java SEйЗНйЪЊзВєгАБеМЕеРЂдљЖдЄНйЩРдЇОйЫЖеРИгАБе§ЪзЇњз®ЛгАБж≥ЫеЮЛгАБеПНе∞ДгАБI/OпЉЫ Java WebйЗНйЪЊзВєпЉМеМЕеРЂдљЖдЄНйЩРдЇОServletгАБJSPгАБ...